DeepSeek V4: Qué Esperar de MODEL1, Engram y Sparse FP8

El nuevo DeepSeek V4 promete un gran avance para los modelos de gran tamaño al combinar capacidades de contexto largo, inferencia de menor coste y una recuperación de memoria optimizada. Las filtraciones recientes y los informes técnicos señalan cuatro avances fundamentales: una caché KV por niveles (MODEL1), decodificación de precisión mixta Sparse FP8, un módulo de memoria Engram para el recuerdo a largo plazo y conexiones residuales optimizadas por mHC para un entrenamiento más ágil. Juntos, estos elementos hacen que el código de múltiples archivos y los agentes de varias sesiones sean mucho más prácticos con la tecnología de DeepSeek V4.

Parte 1. DeepSeek V4: ¿Cuáles son los aspectos más destacados?

DeepSeek V4 tiene como objetivo desbloquear una IA de contexto verdaderamente largo con una ventana de 1 millón de tokens, una caché KV por niveles mediante MODEL1 para la descarga de memoria del host, decodificación Sparse FP8 para una inferencia más rápida, una capa de memoria a largo plazo Engram y residuales mHC que aceleran el entrenamiento y aumentan la estabilidad. Estos cambios apuntan al rendimiento, la escala y la reducción de costes.

- 1.Ventana de contexto de 1 millón de tokens: V4 lleva los límites del contexto de decenas de miles a aproximadamente un millón de tokens, permitiendo el análisis de bases de código completas o documentos extensos.

- 2.Caché KV por niveles con MODEL1: Una jerarquía de almacenamiento coloca los datos KV más utilizados en la GPU, los de frecuencia media en la RAM y los archivos KV históricos en el disco, reduciendo las necesidades de memoria de la GPU mientras amplía el contexto.

- 3.Decodificación Sparse FP8 (precisión mixta): La precisión selectiva utiliza FP16 para tokens críticos y Sparse FP8 para otros, logrando grandes aceleraciones con una pérdida mínima de calidad.

- 4.Módulo de memoria Engram: Una capa de memoria a largo plazo respaldada por vectores separa el contexto transitorio de los recuerdos duraderos (preferencias, decisiones de diseño, historial del proyecto) para agentes personalizados de sesiones múltiples.

- 5.Conexiones residuales optimizadas por mHC: El escalado residual aprendible por capa ayuda a una convergencia más rápida, un entrenamiento más fluido y mejoras modestas en la calidad.

- 6.Soporte nativo multimodal y optimización de hardware: El modelo V4 está construido pensando en entradas multimodales y ajustado para una amplia gama de hardware de inferencia.

- 7.Ecosistema y contexto estratégico: El lanzamiento de DeepSeek V4 se observa como parte de una carrera de IA más amplia que plantea interrogantes sobre gobernanza, seguridad y cooperación internacional.

Parte 2. DeepSeek V4: ¿Qué puede hacer la nueva arquitectura?

La arquitectura de DeepSeek V4 replantea la inferencia y la memoria: MODEL1 reduce la presión sobre la memoria de la GPU al descargar la mayor parte del estado KV a la RAM y al disco, la tecnología Sparse FP8 acelera la decodificación mediante el uso de menor precisión para tokens no críticos, Engram proporciona memoria recuperable a largo plazo y los residuales mHC aceleran el entrenamiento y estabilizan el aprendizaje. Juntos, hacen que los agentes con estado y de largo contexto sean asequibles a escala.

Arquitectura MODEL1: caché KV por niveles y por qué es importante

El problema: Las cachés KV tradicionales escalan linealmente con el historial de tokens y agotan rápidamente la VRAM de la GPU durante la inferencia de sesiones largas.

La solución de MODEL1: Coloca los pares KV activos en la VRAM de la GPU, los KV de frecuencia media en la RAM de la CPU y los KV históricos en el disco. Esa descarga puede reducir drásticamente las necesidades de memoria de la GPU, ampliar los contextos prácticos más allá de los límites anteriores y reducir costes en comparación con mantener todo en la GPU. Los casos de uso real de DeepSeek V4 incluyen la revisión de repositorios de código completos, análisis de documentos masivos y asistentes coherentes de sesiones múltiples.

Sparse FP8 Decoding: inteligencia de precisión mixta

La clave: Solo un subconjunto de tokens influye fuertemente en la computación del siguiente token. Al calificar la importancia del token rápidamente, el modelo calcula los tokens críticos con mayor precisión y el resto en Sparse FP8.

Resultados: Una cobertura de FP8 mucho mayor, casi duplicando el rendimiento de la inferencia mientras se mantiene mínima la pérdida de precisión; una palanca de coste fundamental para servicios de alto volumen.

Módulo de memoria Engram: más allá de las ventanas de contexto

Contexto frente a memoria: DeepSeek V4 separa el contexto de trabajo efímero de los recuerdos seleccionados a largo plazo almacenados en una base de datos vectorial.

Cómo ayuda: En lugar de procesar historiales completos, los sistemas extraen y almacenan datos relevantes, recuperando solo lo que es pertinente, permitiendo asistentes persistentes que recuerdan tus preferencias y decisiones de proyectos anteriores.

Residuales optimizados por mHC: dinámicas de entrenamiento más inteligentes

Qué cambia: Las conexiones residuales ganan factores de escala aprendibles por capa para que la red pueda enfatizar o reducir la contribución de cada capa.

Beneficios: Entrenamiento más rápido, convergencia más suave y una mejora medible en la calidad con un menor gasto de cómputo.

Parte 3. ¿Cuándo llegará DeepSeek V4?

Las primeras señales e informes sugieren que DeepSeek está programando el anuncio de V4 alrededor de la primera semana de marzo de 2026, con múltiples medios y hilos comunitarios apuntando a una ventana de lanzamiento en la misma semana de la Fiesta de las Linternas, el 3 de marzo de 2026. Persiste la incertidumbre hasta que haya un comunicado oficial, por lo que los observadores esperan un anuncio o un despliegue por etapas en cualquier momento dentro de ese plazo.

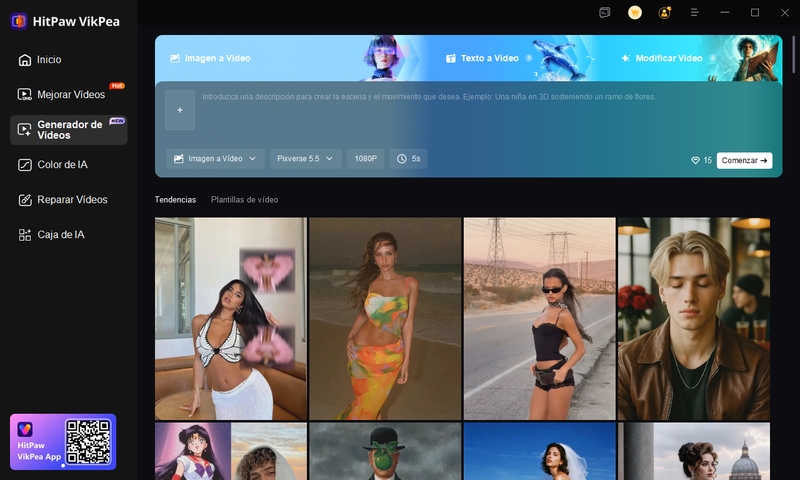

Consejos adicionales: Crea vídeos impresionantes con HitPaw VikPea Generador de vídeos con IA

Si buscas una forma práctica y sencilla de probar flujos de trabajo generativos modernos mientras esperas noticias del modelo, HitPaw VikPea ofrece generación de texto a vídeo e imagen a vídeo, además de potentes herramientas de mejora. VikPea combina múltiples modelos creativos, controles preestablecidos fáciles y mejora a nivel de fotograma para que tú, como creador, puedas construir clips cortos, transformar imágenes en movimiento o perfeccionar metraje antes de publicarlo. Es una opción pragmática para quienes necesitan resultados visuales de alta calidad sin conocimientos profundos de IA generativa.

- Generación de vídeo con IA a partir de texto o imágenes para una producción creativa rápida.

- Múltiples modelos de IA optimizados para diferentes estilos y direcciones estéticas.

- Ajustes de resolución y duración personalizables para controlar el tamaño del vídeo final.

- Canal de mejora integrado que aumenta la claridad, el color, la nitidez y reduce el ruido.

- Interfaz intuitiva diseñada para obtener resultados rápidos sin necesidad de experiencia técnica.

- Procesamiento por lotes y compatibilidad de formatos para flujos de trabajo profesionales.

Paso 1. Instala y abre VikPea en tu Windows o Mac, luego elige la herramienta Generador de vídeos con IA en el menú principal.

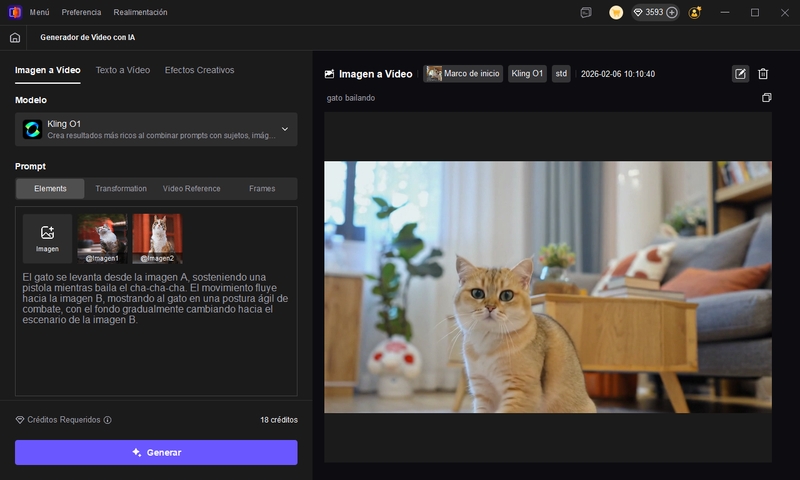

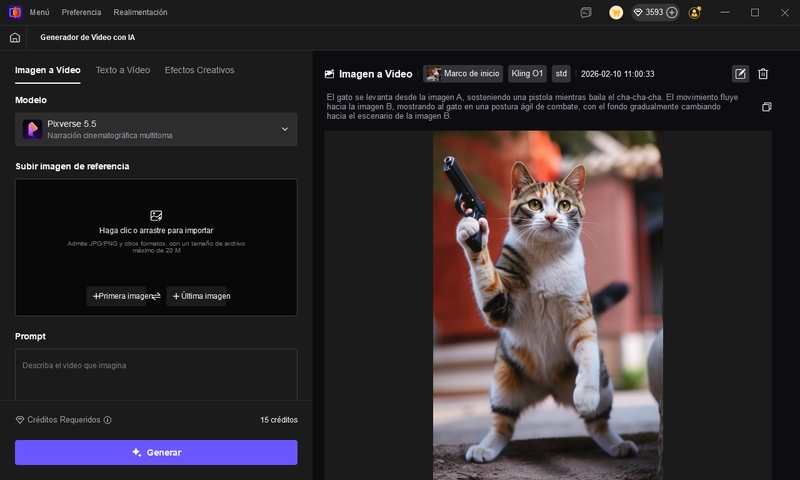

Paso 2. Introduce una descripción de texto o sube tus imágenes: elige Texto a vídeo para clips basados en prompts o Imagen a vídeo para movimiento basado en fotogramas.

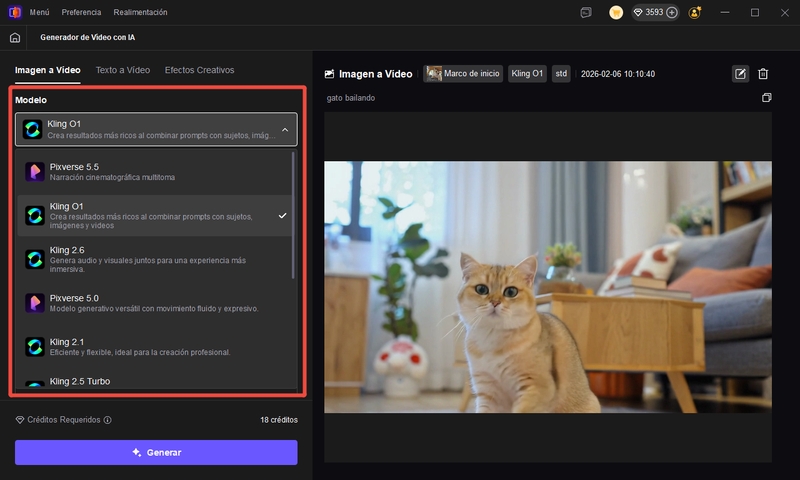

Paso 3. Selecciona un modelo y ajusta la configuración de salida, como la duración, la resolución y los controles de estilo.

Paso 4. Haz clic en Generar, previsualiza el resultado y luego guárdalo o ejecuta el potenciador integrado para el acabado final.

Parte 5. Preguntas frecuentes sobre DeepSeek V4

Las filtraciones y las pruebas comparativas iniciales sugieren que el modelo V4 está optimizado para la programación y el razonamiento de repositorios largos, pero hasta que se publiquen comparaciones independientes revisadas por expertos, es prematuro llamarlo el mejor modelo definitivo. Se esperan grandes avances en el razonamiento de código, aunque el "mejor" real dependerá de la tarea, la latencia y la seguridad.

Los hilos de Reddit combinan la agregación de filtraciones, pruebas de desarrolladores y el entusiasmo de la comunidad a medida que los lectores analizan fragmentos de código, referencias a MODEL1 y ejecuciones de prueba. Una mezcla de señales creíbles de repositorios y especulación alimenta el alto interés en la conversación.

Actualiza tus herramientas para que admitan la descarga de memoria del host, explora patrones de memoria vectorial, prueba la inferencia de precisión mixta y planifica conjuntos de evaluación para tareas de contexto largo. Además, asegúrate de que los controles de gobernanza y los procesos de revisión de seguridad estén listos para las nuevas capacidades de DeepSeek V4.

Conclusión

DeepSeek V4 parece ser un lanzamiento de ingeniería fundamental que prioriza la escala práctica: contextos mucho más largos, inferencia más barata y memorias persistentes que permiten a los agentes actuar más como compañeros de equipo que como herramientas efímeras. Aunque la verificación final aguarda al lanzamiento oficial y a los benchmarks independientes, las ideas arquitectónicas —la jerarquización de MODEL1, la decodificación Sparse FP8, la memoria Engram y los residuales mHC— son herramientas concretas para hacer que una IA personalizada y de contexto largo sea útil y asequible. Mantente atento a la ventana del anuncio oficial y realiza pruebas de integración tempranas con herramientas como HitPaw VikPea si deseas experimentar hoy mismo con flujos de trabajo creativos multimodales.

Deja un comentario

Crea tu reseña para los artículos de HitPaw